Auto-piégés par les Deepfakes : où sont les bugs ? Le paradoxe du ChatBlanc.

Publié par Yannick Chatelain, le 13 février 2024 1k

Par Dr Sylvie Blanco, Professor Senior Technology Innovation Management à Grenoble École de Management (GEM) & Dr. Yannick Chatelain Associate Professor IT / DIGITAL à Grenoble École de Management (GEM) & GEMinsights Content Manager.

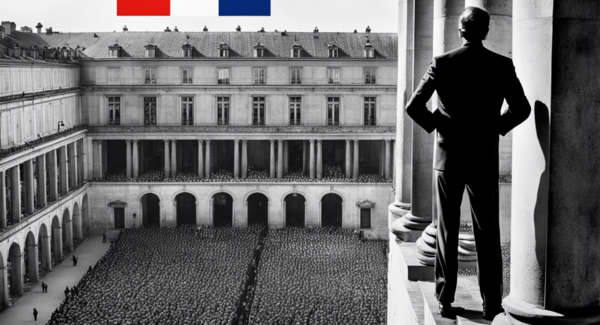

Source : image générée par l'IA !

Si le chemin vers la diffusion massive de l’IA générative est clair, éprouvé et explicable, d’où vient la crise actuelle autour des deepfake ?

Source : image générée par IA

Par Dr Sylvie Blanco, Professor Senior Technology Innovation Management à Grenoble École de Management (GEM) & Dr. Yannick Chatelain Associate Professor IT / DIGITAL à Grenoble École de Management (GEM) & GEMinsights Content Manager.

« C’est magique, mais ça fait un peu peur quand même ! » dit Hélène Michel, professeur à Grenoble Ecole de Management, alors qu’elle prépare son cours « Innovation et Entrepreneuriat ». Et d’ajouter, en riant un peu jaune : « Regarde, en 20 minutes, j’ai fait le travail que je souhaite demander à mes étudiants en 12 heures. J’ai créé un nouveau service, basé sur des caméras high tech et de l’intelligence artificielle embarquée, pour des activités sportives avec des illustrations de situations concrètes, dans le monde réel, et un logo, comme si c’était vrai ! Je me mettrai au moins 18/20 ». Cet échange peut paraître parfaitement anodin, mais la possibilité de produire des histoires et des visuels fictifs, perçus comme authentiques – des hypertrucages (deepfakes en anglais) – puis de les diffuser instantanément à l’échelle mondiale, suscitant fascination et désillusion voire chaos à tous les niveaux de nos sociétés doit questionner. Il y a urgence ! En 2024, quel est leur impact positif et négatif ? Faut-il se prémunir de quelques effets indésirables immédiats et futurs, liés à un déploiement massif de son utilisation et où sont les bugs ?

DeepFake : essai de définition et origine

En 2014, le chercheur Ian Goodfellow a inventé le GAN (Generative Adversarial Networks), une technique à l’origine des deepfakes. Cette technologie utilise deux algorithmes s’entraînant mutuellement : l’un vise à fabriquer des contrefaçons indétectables, l’autre à détecter les faux. Les premiers Deepfakes sont apparus en novembre 2017 sur Reddit où un utilisateur anonyme nommé « u/deepfake » a créé le groupe subreddit r/deepfake. Il y partage des vidéos pornographiques avec les visages d’actrices X remplacés par ceux de célébrités hollywoodiennes, manipulations reposant sur le deep learning. Sept ans plus tard, le mot « deepfake » est comme entré dans le vocabulaire courant. Le flux de communications quotidiennes sur le sujet est incessant, créant un sentiment de fascination en même temps qu’une incapacité à percevoir le vrai du faux, à surmonter la surcharge d’informations de manière réfléchie.

Ce mot deepfake, que l’on se garde bien de traduire pour en préserver l’imaginaire technologique, est particulièrement bien choisi. Il contient en soi, un côté positif et un autre négatif. Le « deep », de deep learning, c’est la performance avancée, la qualité quasi authentique de ce qui est produit. Le fake, c’est la partie « trucage », la tromperie, la manipulation. Si on revient à la réalité de ce qu’est un deepfake (un trucage profond), c’est une technique de synthèse multimédia (image, son, vidéos, texte), qui permet de réaliser ou de modifier des contenus grâce à l’intelligence artificielle, générant ainsi, par superposition, de nouveaux contenus parfaitement faux et totalement crédibles. Cette technologie est devenue très facilement accessible à tout un chacun via des applications, simples d’utilisations comme Hoodem, DeepFake FaceSwap, qui se multiplient sur le réseau, des solutions pour IOS également comme: deepfaker.app, FaceApp, Zao, Reface, SpeakPic, DeepFaceLab, Reflect.

Des plus et des moins

Les deepfakes peuvent être naturellement utilisés à des fins malveillantes : désinformation, manipulation électorale, diffamation, revenge porn, escroquerie, phishing… En 2019, la société d’IA Deeptrace avait découvert que 96 % des vidéos deepfakes étaient pornographiques et que 99 % des visages cartographiés provenaient de visages de célébrités féminines appliqués sur le visage de stars du porno (Cf. Deep Fake Report : the state of deepfakes landscape, threats, and impact, 2019). Ces deepfakes malveillants se sophistiquent et se multiplient de façon exponentielle. Par exemple, vous avez peut-être été confrontés à une vidéo où Barack Obama traite Donald Trump de « connard total », ou bien celle dans laquelle Mark Zuckerberg se vante d’avoir « le contrôle total des données volées de milliards de personnes ». Et bien d’autres deepfakes à des fins bien plus malveillants circulent. Ce phénomène exige que chacun d’entre nous soit vigilant et, a minima, ne contribue pas à leur diffusion en les partageant.

Si l’on s’en tient aux effets médiatiques, interdire les deepfakes pourrait sembler une option. Il est donc important de comprendre qu’ils ont aussi des objectifs positifs dans de nombreuses applications : dans le divertissement pour créer des effets spéciaux plus réalistes et immersifs, pour adapter des contenus audiovisuels à différentes langues et cultures ; dans la préservation du patrimoine culturel, à des fins de restauration et d’animation historiques ; dans la recherche médicale pour générer des modèles de patients virtuels basés sur des données réelles, ce qui pourrait être utile dans le développement de traitements ; dans la formation et l’éducation, pour simuler des situations réalistes et accroître la partie émotionnelle essentielle à l’ancrage des apprentissages. Ainsi, selon une nouvelle étude publiée le 19 avril 2023 par le centre de recherche REVEAL de l’université de Bath : « Regarder une vidéo de formation présentant une version deepfake de vous-même, par opposition à un clip mettant en vedette quelqu’un d’autre, rend l’apprentissage plus rapide, plus facile et plus amusant ». (Clarke & al., 2023)

Comment en est-on arrivés là ?

Retrouvez l'intégralité de l'article sur CONTREPOINTS